现在是时候使用Docker安装一个多节点Codenvy On-Prem和Eclipse Che了。

Docker容器包装一块软件到一个文件系统,这里面包含一切它运行的要素:code, runtime, system tools, 以及libraries。不管运行环境如何,容器总是保证相同的运行。容器将打包和部署转化为独立单元,使软件开发团队更容易提高DevOps效率。

Codenvy一直使用容器支持builds, runners以及 workspaces好几年了。我们现在支持在容器内运行Codenvy。

Eclipse Che

Eclipse Che是一个现代的、开放源代码的软件开发环境。它是一个通过提供结构化的工作区、项目输入、模块化扩展插件来支持Codenvy的引擎。Che可以用作桌面IDE,RESTful工作空间服务器,或作为一个创建新的工具SDK。我们现在支持一个有标签的Docker images启动一个默认Eclipse Che。

容器的容器是无状态的,重复运行将清除保存在容器内数据。你可以保存你的工作区到外部容器的external volume。

如果你不想麻烦安装volume,还可以snapshot容器,并且保存一个新的image到本地磁盘。然后你可以启动保存的图像,它重启容器在最后保存的状态。这个过程是有状态的,但你必须等待snapshot 写和读操作完成。

Multi-Node Codenvy On-Prem

Codenvy On-Prem 是Codenvy的一个版本,你可以运行在自己的服务器上。也可以作为一个单节点(在一个主机上)或作为一个多节点系统运行 (服务跨集群以及分布在不同的主机上)。对我们来说,简单和快速安装、升级、备份,并定制Codenvy On-Prem一直是我们的最高目标。

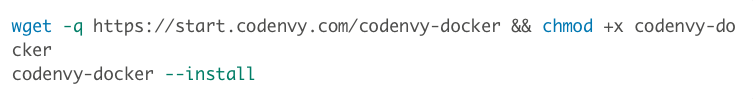

你现在可以使用Docker安装Codenvy On-Prem多节点。

虽然这安装技术是生产测试,请阅读下面的报告,你可以熟悉一下这里面的一些特定的访问控制和使用Docker可能会遇到的风险。这个安装程序只支持Linux。

Some Special Codenvy Magic

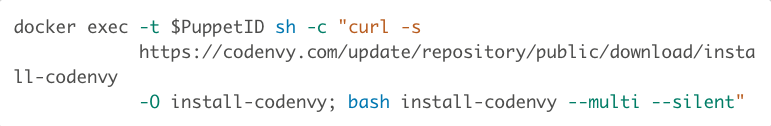

Codenvy On-Prem需要八个节点。有了这个安装程序,我们在它们自己的容器启动每个节点。八大容器都是相同的——从一个specialized CentOS 7 image的实例化。空CentOS容器启动后,我们调用Codenvy’s bootstrap installer,依次进行,Puppet下载安装并配置Codenvy。

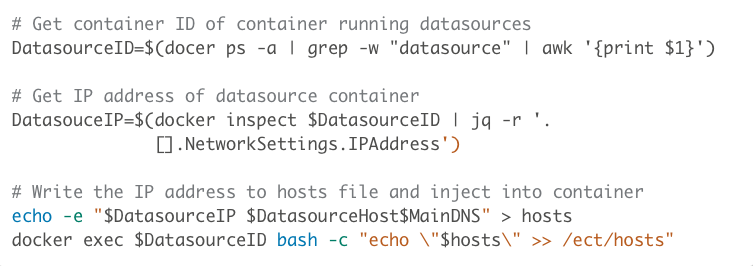

Codenvy需要每个节点配置一个匹配字符串模式的hostname。但是为了各种容器看到对方,存在于每个容器的/etc/hosts文件必须随着其他容器的IP地址更新。这些IP地址将在容器启动之后才会知道。所以安装程序有一些额外的逻辑启动容器,发现它们的IP地址,并执行到每个容器,并随着其他容器的IP地址更新/etc/hosts文件。我们执行这项工作来创建一个可发现的、连接网络的容器,验证之后,Codenvy引导安装开始。当重启已经保存的容器,我们做一个类似的进程利用任一个新的IP地址更新每个容器。

看似简单的容器。从表面上看,它们是很小的部署单位。你从一个image激活一个容器就搞定一切。容器执行通常是无状态的,每个执行不记得之前的执行。这意味着内部状态数据,比如我们在LDAP和MongoDB对用户的存储必须具体化。

你可以从一个用于未来运行的容器创建新的images。我们已经嵌入停止和重启选项到安装脚本里,这会让你的容器状态作为layer写进image。在将来的版本中,我们将支持容器编排器Docker Swarm,这将给你另外一种方法具体化内部数据。

Security & Stability Considerations

Codenvy On-Prem的Docker安装不支持单节点配置。单节点Codenvy打包非常打,而且Docker不适合在一个容器中运行数十个微服务。

Codenvy On-Prem multi-node所有的容器必须在特权模式下运行,这种模式允许容器以near-root访问进程和运行在其主机上的文件。这是必要的,有两个原因:

1。我们的runner nodes必须在Docker里面运行Docker容器。

2。我们使用Puppet执行内部配置管理,它需要访问所有节点,甚至一些等底层主机如AppArmor或SELinux的文件。

特许模式在不同的操作系统下不稳定。你可以尝试一下。

本文由赵帅龙编译整理,转载请注明出自TenxCloud。

英文原文链接:http://blog.codenvy.com/eclipse-che-codenvy-docker/

京ICP备14045471号

京ICP备14045471号